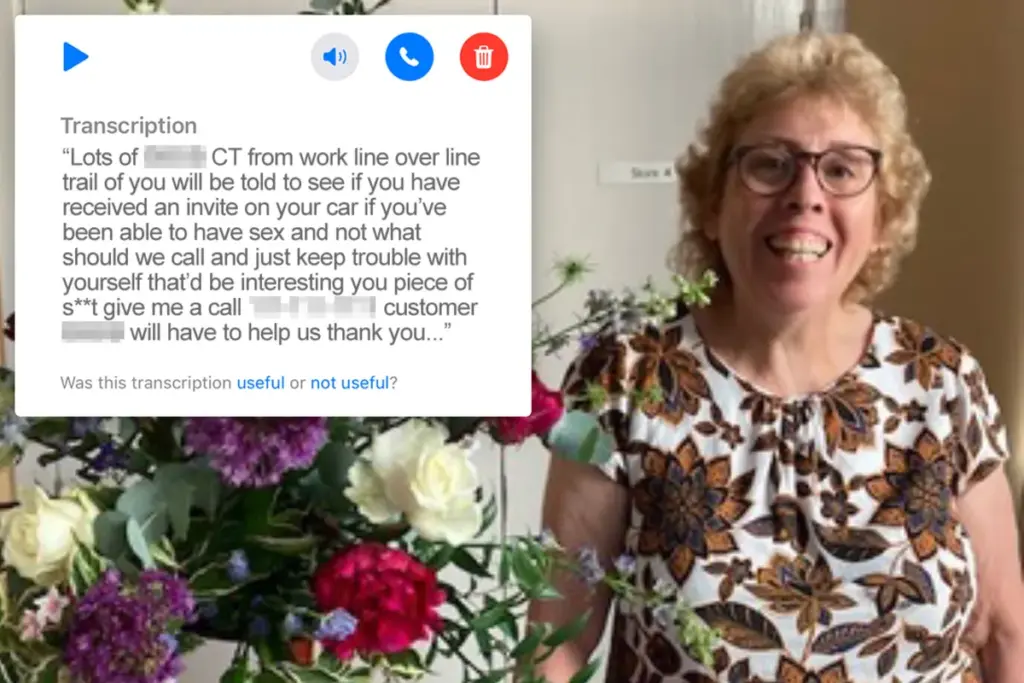

Het klinkt haast als een mop, maar het is 2025 — zelfs in Nederland kan spraakherkenning van Apple flink uit de bocht vliegen. Dat ontdekte de 66-jarige Louise Littlejohn uit Dunfermline, toen ze een bizar voicemailbericht ontving vol ongepaste taal en seksuele toespelingen. En dat allemaal dankzij de AI-dictee software van haar iPhone.

Van nette uitnodiging naar ongepaste boodschap

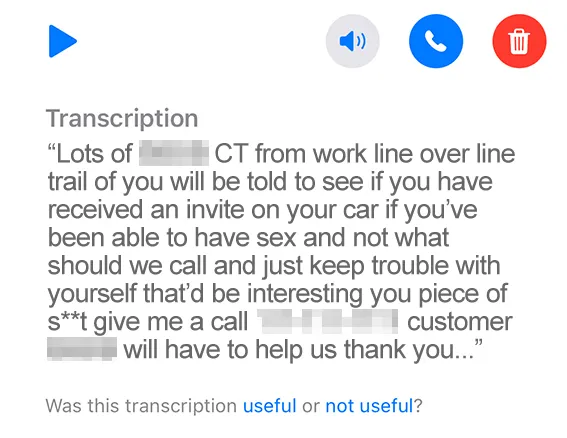

Louise kreeg woensdag een voicemail van Lookers Land Rover in Motherwell. Het leek een gewone uitnodiging voor een event — tot ze de automatische transcriptie las. Wat ooit bedoeld was als beleefd bericht, veranderde in een tekst waarin ze werd uitgemaakt voor “stuk stront”, met de vraag of ze “nog seks had gehad”. U begrijpt, niet bepaald de toon die de garage voor ogen had.

Wie is hier verantwoordelijk? Niet de afzender, wel de techniek

In eerste instantie dacht Louise dat ze het slachtoffer was van spam — of zelfs een slechte grap. Tot ze het netnummer herkende en zich realiseerde: dit is echt van mijn garage. Ze reageerde sportief: “De verkopers willen gewoon auto’s verkopen. In plaats daarvan sturen ze onbedoeld grove berichten — en weten dat niet eens.”

Waarom gaat het mis? Accent, ruis en scripts

- Accent en dialect: De Schotse tongval is pittig, maar zelfs een stevige Twentse uitspraak kan AI van slag maken.

- Achtergrondgeluiden: Bel je bijvoorbeeld vanuit een drukke showroom of met wind op de lijn? Grote kans op fouten.

- Voorlezen van een script: Dat klinkt vaak onnatuurlijk, waardoor de software sneller ontspoort.

Volgens Peter Bell, hoogleraar spraaktechnologie aan de University of Edinburgh, stapelen dergelijke factoren zich op. tehnisch is alles aanwezig, maar de praktijk in 2025 loopt soms nog spaak.

‘Zesde maart’ of ‘seks’? Kleine fout, groot verschil

Tech-experts van de BBC vermoeden dat de verwarring over “sex” simpelweg ging om “sixth” — de zesde maart, datum van het event. Heel even lijkt het met robots net een potje ‘telefoon’ zoals we vroeger speelden: één woord verkeerd en de boodschap is foetsie.

Iets om om te lachen, maar ook om over na te denken

Louise kan inmiddels de humor van het incident wel inzien: “Eerst was ik echt geschokt — nu lig ik er dubbel om.” Toch wijst professor Bell op een serieus probleem: “Als je zulke AI-systemen publiekelijk inzet, verwacht je dat er veilige filters zijn voor dit soort uitglijders.”

Het grotere plaatje: AI en menselijke taal

Deze fout staat niet op zichzelf. Vorige maand kreeg Apple kritiek toen het woord “racist” als “Trump” werd uitgeschreven — en dat was geen unicum. Volgens Apple verschijnen er soms tijdelijk woorden die klanktechnisch lijken op het bedoelde — voor correctie alsnog plaatsvindt.

Voor nu: let goed op automatische transcripties, of je nu bellen bij MediaMarkt Amsterdam of de huisarts in Utrecht. AI is handig, maar mensentaal blijft voorlopig een vak apart.